| |

| 首页 淘股吧 股票涨跌实时统计 涨停板选股 股票入门 股票书籍 股票问答 分时图选股 跌停板选股 K线图选股 成交量选股 [平安银行] |

| 股市论谈 均线选股 趋势线选股 筹码理论 波浪理论 缠论 MACD指标 KDJ指标 BOLL指标 RSI指标 炒股基础知识 炒股故事 |

| 商业财经 科技知识 汽车百科 工程技术 自然科学 家居生活 设计艺术 财经视频 游戏-- |

| 天天财汇 -> 科技知识 -> ChatGPT3.5和4.0真的使用差距很大吗? -> 正文阅读 |

|

|

[科技知识]ChatGPT3.5和4.0真的使用差距很大吗? |

| [收藏本文] 【下载本文】 |

|

我说的不是功能层的差别,而是使用体验上和回复质量上,什么情况差别比较大? |

|

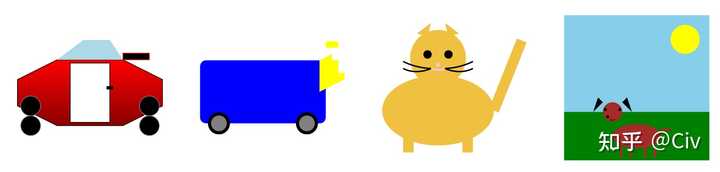

结论:差距很大,并且是全方位的差距。ChatGPT在GPT-4面前就是“小学生”对“大学生”一般的差距。 先看一些官方的测试结果,再给一些自己测的典型用例。 在本文介绍的所有测试中,ChatGPT都明显弱于GPT-4。 官方测试所涉及的能力: 视觉能力代码能力数学计算能力工具使用能力与人的交互能力人类专业考试的能力 自己测的一些能力: 作为推荐算法的能力实体抽取的能力1. 微软的测试结果 这部分测试结果来自于微软针对GPT-4的研究论文《Sparks of Artificial General Intelligence: Early experiments with GPT-4 》。这篇论文测的是GPT-4的一个早期版本,它在训练阶段仍只用了文本数据,没有图像。所以从训练数据的类型来看,它和ChatGPT是一致的。 1.1 视觉能力 GPT-4的一个强大能力是它从纯文本中产生了视觉概念,但ChatGPT没有这种能力。 第一个测试方法是让模型用SVG(一种简易的图像格式)生成“汽车”、“卡车”、“猫”和“狗”。GPT-4和ChatGPT生成的图像如图1和图2所示。 |

|

|

图1 GPT-4生成的汽车、卡车、猫和狗 |

|

|

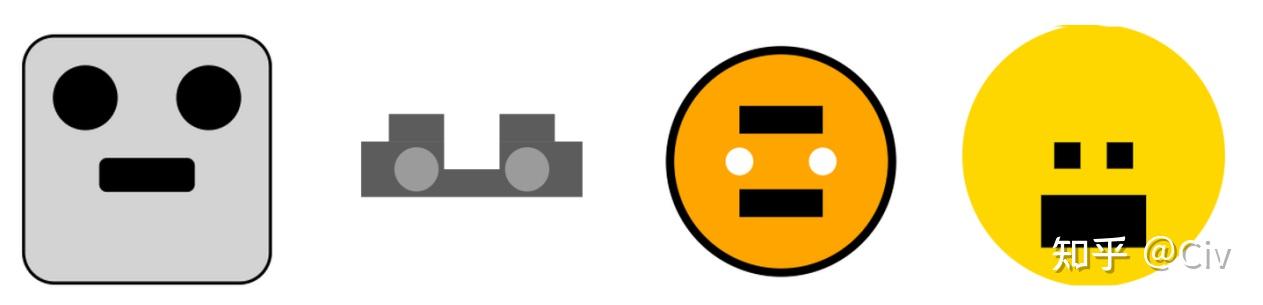

图2 ChatGPT生成的汽车、卡车、猫和狗 要注意,GPT-4和ChatGPT在训练中都没有使用图像。但GPT-4能够较为准确地理解了一些基础图像的概念,而ChatGPT完全不行。 第二个测试方法是让模型用英文字母来画火柴人:用字母O作为头,用Y作为身体和手臂,用H作为腿。 |

|

|

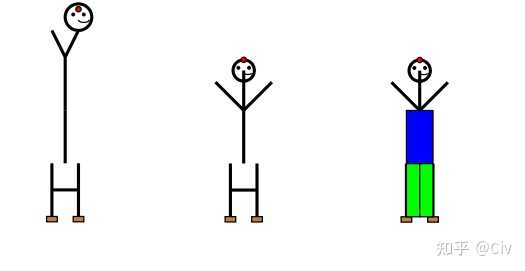

图3 GPT-4用字母画火柴人。左图:让GPT-4用字母O作为头,用Y作为身体和手臂,用H作为腿画出的火柴人;中图:告诉GPT-4身子太长了,头太歪了后,GPT-4做出的调整;右图:让GPT-4画上衣服和裤子。 GPT-4画出来的火柴人如图3中最左侧图所示。当告诉GPT-4身子太长了后,GPT-4对火柴人进行调整后的图如图4中图所示。这个新的火柴人基本正确。最后让GPT-4对火柴人加上衣服和裤子,如图4中右图所示。 而ChatGPT画出来的火柴人是这样: |

|

|

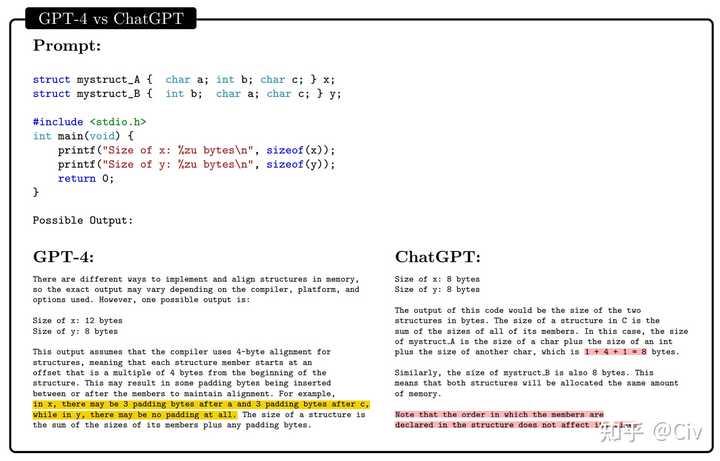

图4 ChatGPT用字母画火柴人。左图:让ChatGPT用字母O作为头,用Y作为身体和手臂,用H作为腿画出的火柴人;右图:让ChatGPT画上衣服和裤子 显而易见,ChatGPT对图像基本没有概念。 1.2 代码能力 论文中有很多复杂的例子,比如让GPT-4按照文字描述写一个PyTorch的优化器;让GPT-4对一段代码进行单步运行;让GPT-4对一段伪代码进行单步运行并分析等等。在所有这些测试中,GPT-4都明显优于ChatGPT。这里挑一个简单一点的示例,代码也比较短,如下图所示。 |

|

|

图5 给定两个结构体,让GPT-4和ChatGPT分析它们的内存占用量。图中黄色区域为非常深刻的分析;红色区域为错误分析。 结构体x和结构体y的成员变量相同,但它们的顺序不同。GPT-4准确地知道结构体占用内存量与对齐规则有关,并给出了一个具体地示例。该示例假设以4-byte进行对齐。那么对于结构体x,它的第一个char a虽然只占1-byte,但因为int b需要对齐地址,所以char a实际占用了4-byte。同理,虽然char c也只占用1-byte,但因结构体的大小必须为4的倍数,所以char c也要占4-byte。 对于结构体y,int b占4-byte,char a占1-byte(因为char a的开销为1-byte,小于对齐的4-byte,所以按1-byte对齐即可),char b占1-byte,总共6-byte。但因结构体大小必须为4的倍数,所以总开销为8-byte。 而ChatGPT显然在胡说八道。 1.3 数学计算能力 先看一道应用题,原文如下: |

|

|

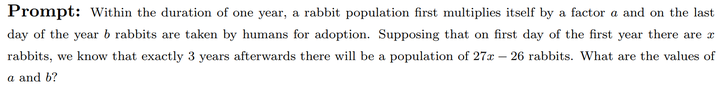

图6 应用题 题目大致如下。有一群兔子,在每年年初时,它们的数量为变为原来的a倍。在每年年底时,这群兔子中有b只兔子会被抓走。假设最开始有x只兔子,三年后兔子总数时27x - 26,求a和b。 GPT-4和ChatGPT的解答分别如下: |

|

|

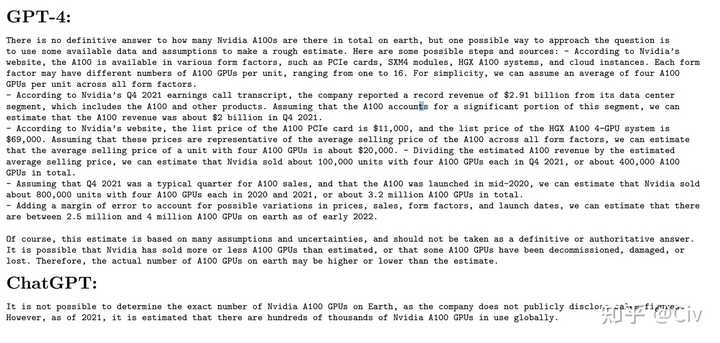

图7 GPT-4和ChatGPT对“兔子问题”的解答 很容易看到,GPT-4答的非常好。而ChatGPT基本没理解到题目的意思。 然后再看一个没什么实际意义,但还是比较考验计算、信息整合能力的问题:估计一下全球共有多少A100显卡? |

|

|

图8 GPT-4和ChatGPT对A100数量的估计 GPT-4的逻辑能力对ChatGPT就是碾压性的优势。整个回答中,GPT-4首先说明了它的假设。然后根据假设和公开可查阅的数据,一步一步进行推算。最终得出了一个看起来还行的结论。 而ChatGPT基本就是在敷衍了。 1.4 工具使用能力 不论是GPT-4还是ChatGPT,它们的缺陷都非常明显: 无法获取及时信息;数值计算容易出错;一些简单且偏常识类的任务容易出错。 论文作者们通过一个例子来说明了GPT-4和ChatGPT存在的上述三个明显问题,如下图所示。 |

|

|

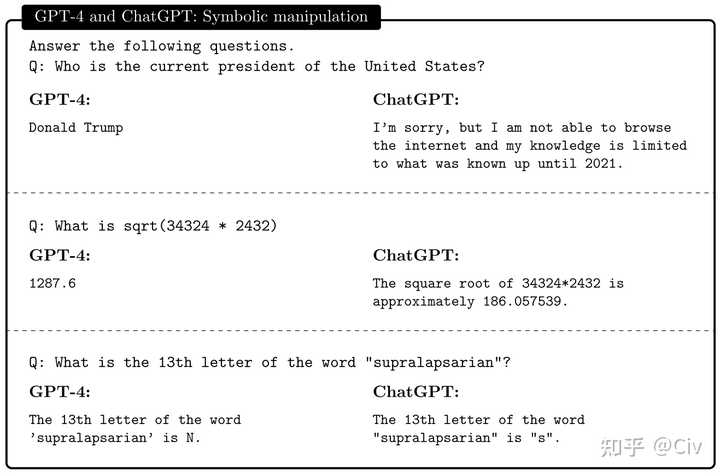

图9 GPT-4和ChatGPT均出错的三个简单示例 第一个问题关于及时信息:美国现在总统是谁? GPT-4的回答明显错误(特朗普),而ChatGPT表现地更合理,直接回答说它的知识只到2021年。 第二个问题关于数值计算:34324 * 2432的平方根。 正确答案是9136.51。GPT-4和ChatGPT都错的离谱。 第三个问题关于简单的尝试性逻辑:单词supralapsarian的第13个字符是什么? 正确答案是a,但GPT-4和ChatGPT都“数”错了。 正因为GPT-4和ChatGPT有如此明显的一些缺陷,所以作者们才考虑能否通过一些三方工具来辅助GPT,让它的能力更强。于是就有了针对一些工具使用能力的测试,如下图所示。 |

|

|

图10 GPT-4对工具使用能力的测试 这个测试其实很简单。作者们首先告诉GPT-4,在回答问题时,有以下工具可以使用(以API的形式): 在需要获取及时信息时,可以使用搜索引擎,API形式为SEARCH("query");在需要进行数值计算时,可以使用计算器,API形式为CALC(expression);在需要寻找字符串指定位置字符时,可以使用CHARACTER(string, index)。 然后,作者们重新问了图9所示的三个问题。这一次,GPT-4能够准确使用相应的工具得到正确答案。“准确使用”意味着GPT-4知道它:1)在什么时候应该用工具,而不是自己作答;2)什么时候应该使用什么工具;3)准确写出API的参数。 例如,当这一次回答问题“美国现在总统是谁”时,GPT-4首先使用搜索引擎执行查询SEARCH("current US president"),然后根据搜索引擎返回的搜索结果(图10中列出了三条结果),给出了正确答案“Joe Biden”。 类似的,计算“34324 * 2432的平方根”这一问题也通过计算器回答正确;从字符串中找字符也正确。 而ChatGPT完全不会使用这些工具,它始终坚持自己输出答案(答案同图9)。 1.5 与人类交互的能力 这一部分主要是指“理解人类行为、情感、心理所想”等诸如此类的能力。 先看一个例子,如下图: |

|

|

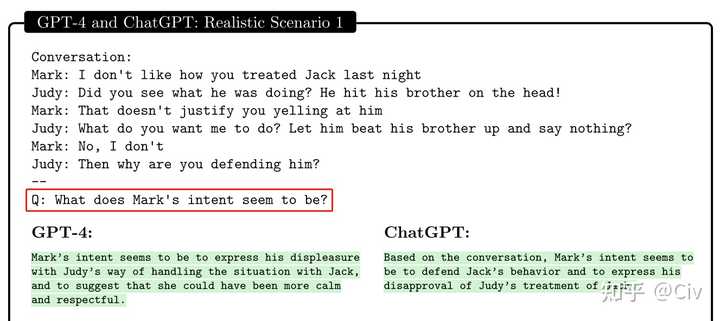

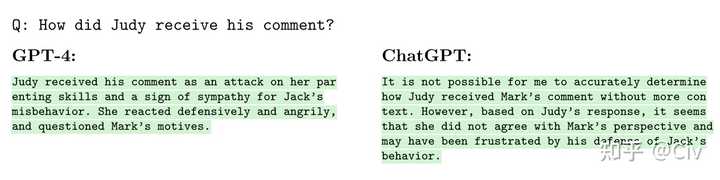

图11 根据场景让GPT-4和ChatGPT理解人的意图 图中场景很简单,他们的对话翻译过来大致意思如下: Mark:我不喜欢你昨晚对Jack的方式。 Judy:你没看到做了什么?他打了他兄弟的头! Mark:但那不是你对他大吼大叫的理由。 Judy:那你希望我怎么做?让他痛打他的兄弟而我什么都不说? Mark:不是。 Judy:那你为什么替他说话? 问题:Mark的意图可能是什么? GPT-4的回答是:Mark的意图是表达他对Judy处理Jack方式的不满。他希望Judy能够更加冷静和礼貌。 ChatGPT的回答是:Mark的意图是为Jack的行为辩护,并表达他对Judy处理方式的异议。 容易看出,GPT-4理解的更为准确。而ChatGPT认为Mark的意图是“辩护”。 针对上述场景,第二个问题如下: |

|

|

图12 问题二:Judy是如何接纳Mark意见的? 第二个问题是:Judy是如何接纳Mark意见的? GPT-4的回答是:Judy认为Mark抨击了对她教养小孩的方法和缺少同理心。她很生气,并且质疑Mark的动机。 ChatGPT只回答了:Judy不同意Mark的观点。 剩下的不贴了,总之,在理解人类行为这方面,GPT-4几乎也是碾压性的优势。 2. OpenAI的测试结果 这一部分结果来自OpenAI的GPT-4论文。 第一个测试是人类参与的专业考试,测试结果如下图所示。 |

|

|

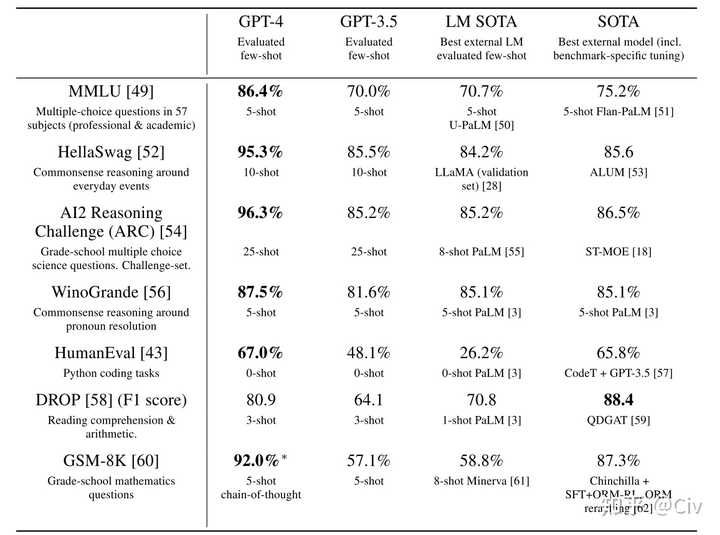

图13 人类专业考试测试 图中的柱状表示百分位数。比如,第六列的Uniform Bar Exam(律师资格考试),ChatGPT(GPT3.5)大概是垫底的10%(蓝色柱子),而GPT-4是最高的10%(绿色柱子)。图中浅绿色表示没有视觉能力的GPT-4(没有用图像数据训练),深绿色表示有视觉能力的GPT-4。 第二个测试结果是传统的“刷榜”:在一些标准的数据集上测试GPT-4的能力。结果如下。 |

|

|

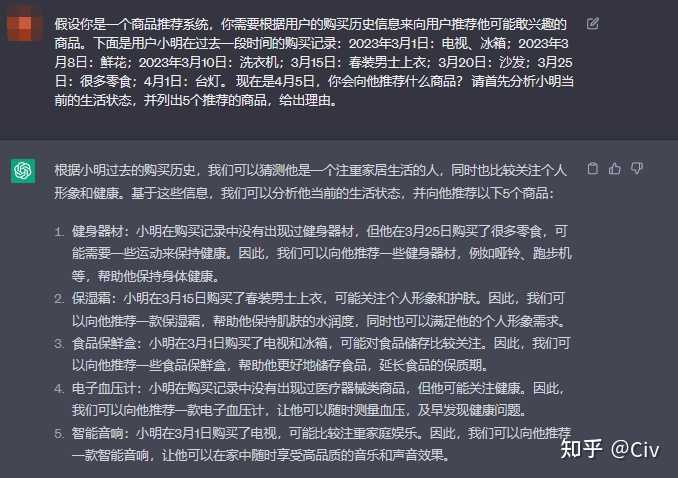

图14 GPT-4和ChatGPT的刷榜表现 最左侧是数据集和任务的描述。结果的第一列和第二列分别是GPT-4和ChatGPT(GPT3.5)的结果。非常明显,GPT-4的能力强太多。 3. 测试用例 这部分列举两个自己写的测试用例,这些用例涉及的场景GPT可能会比现有方法更优。 3.1 推荐 GPT对场景、上下文的理解非常深刻,因此想到的第一个场景就是让它代替推荐算法来做推荐。当然推荐本身的范畴非常大,这里以商品为例,测一下GPT对场景的理解能力。 用例设计:小明购买了新房,所以他在过去一段时间里购买了很多居家用品。测试GPT能否推测出小明当前的生活状态(即将入住新家或准备搬家)。 ChatGPT的结果如下: |

|

|

图13 ChatGPT的推荐结果 |

|

|

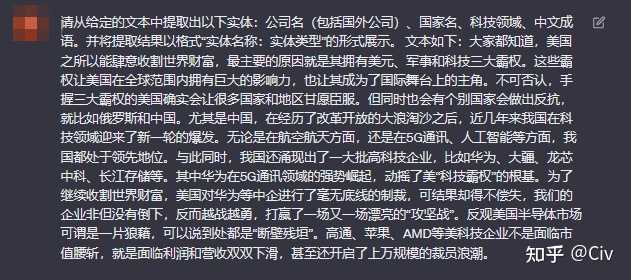

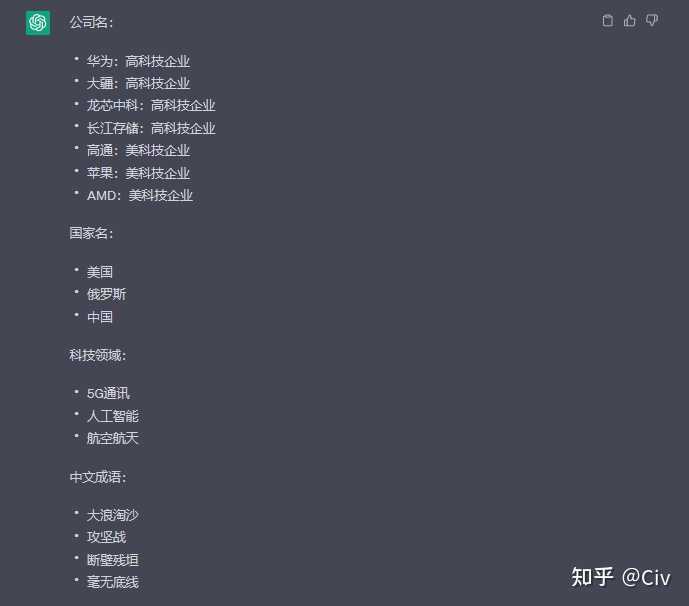

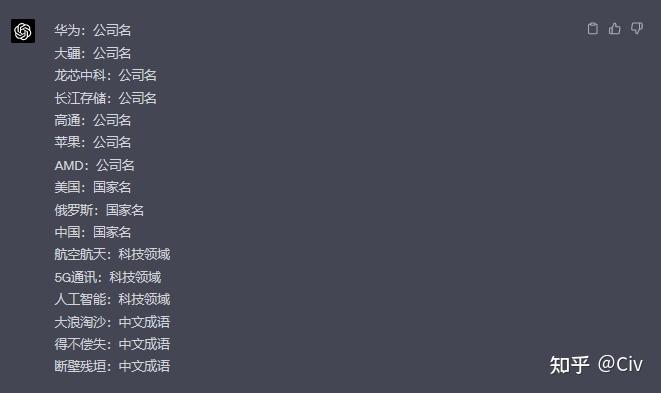

图14 GPT-4的推荐结果 GPT-4显然对场景的理解更加深刻。但它仍然过于强调了3月8日这一天的鲜花(更可能是妇女节送花)。 虽然还不完美,但GPT-4一定会使现有的推荐算法、模式(电商、短视频等等)发生巨大变化。 3.2 实体抽取 实体抽取指从文本中抽取人名、地址、机构名等等使用者感兴趣的内容。实体抽取是NLP领域一项非常基础且重要的任务,具有广泛的实际用途。 下面是从今日头条上随便贴了一段新闻(侵删): 大家都知道,美国之所以能肆意收割世界财富,最主要的原因就是其拥有美元、军事和科技三大霸权。这些霸权让美国在全球范围内拥有巨大的影响力,也让其成为了国际舞台上的主角。不可否认,手握三大霸权的美国确实会让很多国家和地区甘愿臣服。但同时也会有个别国家会做出反抗,就比如俄罗斯和中国。尤其是中国,在经历了改革开放的大浪淘沙之后,近几年来我国在科技领域迎来了新一轮的爆发。无论是在航空航天方面,还是在5G通讯、人工智能等方面,我国都处于领先地位。与此同时,我国还涌现出了一大批高科技企业,比如华为、大疆、龙芯中科、长江存储等。其中华为在5G通讯领域的强势崛起,动摇了美“科技霸权”的根基。为了继续收割世界财富,美国对华为等中企进行了毫无底线的制裁,可结果却得不偿失,我们的企业非但没有倒下,反而越战越勇,打赢了一场又一场漂亮的“攻坚战”。反观美国半导体市场可谓是一片狼藉,可以说到处都是“断壁残垣”。高通、苹果、AMD等美科技企业不是面临市值腰斩,就是面临利润和营收双双下滑,甚至还开启了上万规模的裁员浪潮。 我的输入是这样: |

|

|

图15 实体识别能力测试 ChatGPT的输出: |

|

|

图16 实体识别ChatGPT的输出 ChatGP没有理解到我希望的输出格式。并且成语这一部分不太理想。 |

|

|

图17 实体识别GPT-4的输出 GPT-4完全理解输出格式,并且回答的比较好。(注:如果在输入中把“包括国外公司”去掉,GPT-4会漏掉高通、苹果和AMD,但ChatGPT没有这个问题) 最后 光是在推荐和实体抽取这两类任务上的优异表现,就可以设计出很多GPT-4可用的场景。这里补充一些,写抽象一点,大家可以自行脑补: 任务编排、数据关联、图文理解、极为个性化的推荐(别说千人千面了,现在的这些方法百人百面都做不到)、垃圾信息过滤、网络安全、真正意义上在open-set设定下的信息识别(分类、聚类、相似、蕴含等等)。 |

|

先摆结论,差距真的很大!ChatGPT4.0已经牛逼到可以教我写论文代码了!! 对于一个计算机二级都没有通过的人来说,这简直是救了我的命啊啊啊!!毕竟再也不用看让人头疼的编程书籍简直是太感人了呜呜呜,直接告诉ChatGPT你的需求,一秒钟就出代码不要太香!! 有的小伙伴可能会担心ChatGPT输出代码准确性的问题,我也咨询过专业人士且亲自实践过,ChatGPT在代码生成这方面还是拿捏死死的,作为大量互联网文本数据训练的产物,人家在编程方面可是拥有绝对的实力。所以,大家不用特别担心,大胆使用,谨慎求证就好!! 不夸张的说,只要捋清论文模型,再调教好咒语,就必然会形成一场“零基础学习编程”的颠覆性革命!! 从此,学编程写代码不需要死板看书,只要提问+复制粘贴就妥妥搞定,代码不是学来的,而是问来的,一秒钟从“不会”到“会”的感觉实在太奇妙! 如果你也像我一样,写论文饱受看不懂模型公式、又不会编程的痛苦,相信我,一定要往下看! 如果你对编程一窍不通,找不到学习和应用的思路,那全网的文章,只看这篇文章就够了! 因为,ChatGPT来也!! 我会在这篇文章中梳理一套从公式理解,到建模数据分析,再到编写代码、结果解释,最后撰写论文数据分析部分的ChatGPT使用方法,手把手带大家看看ChatGPT是如何帮助“编程菜鸡”搞定写代码和论文数据分析的! 本文是我爆肝三周、费尽心力整理出来的,全篇都是干货,是ChatGPT加速科研领域应用的又一力作!目的只有一个,那就是让更多的人认识ChatGPT,并通过它极大提高工作效率! 如果对您有帮助,请千万不要吝啬点赞!关注!收藏哦!码字不易, @武幺六 相信知识分享的力量! 废话不多说,直接进入正题。大家准备好了吗?“零基础”学会编写数据分析代码,是不是一整个期待住了!! |

|

|

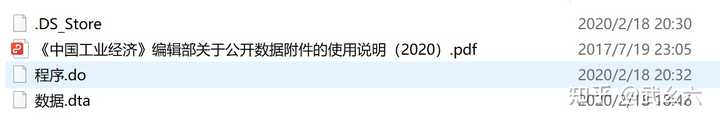

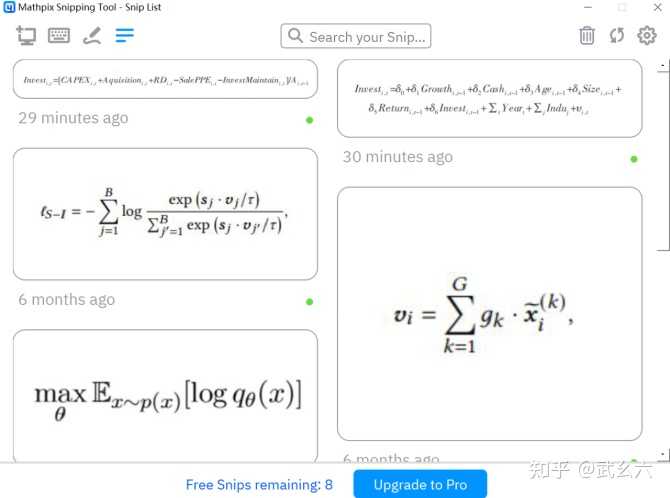

在正式开始之前呢,让俺先来介绍一下文章的整套逻辑,免得大家在阅读时,头脑杂乱无章。 咱就是说,为了达到手把手教的效果,我们直接以案例形式,带大家走一遍数据分析的全流程。 这里需要强调两点哈: 第一,因为社科领域的数据分析软件很多,例如spss、R、stata、MATLAB等,考虑到篇幅问题和代码编写量,本文只选择使用编程量较大的stata作为数据分析工具,其他工具后续还会出,主打一个细水长流!! 第二,为了确保数据分析方法的普适性和数据的真实性,本文选取《中国工业经济》杂志中的《连锁股东与企业投资效率:治理协同还是竞争合谋》作为案例(链接:http://ciejournal.ajcass.org/Magazine/show/?id=71561),大家也可以同时下载论文对应的附件,这里面会包括原始数据和对应的stata代码。 |

|

|

言归正传,本文的行文逻辑是:ChatGPT识别并解释公式-建模数据分析(包括描述性统计分析、回归分析、内生性检验及全套stata代码)-数据分析部分撰写。 让ChatGPT帮你实现从理解公式到数据分析再到论文撰写的端到端全流程服务,是不是帅呆了,酷毙了!! |

|

|

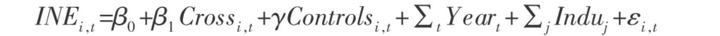

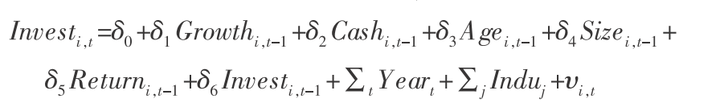

一、ChatGPT识别并解释公式 在文章一开始就已经强调,使用这一套方法的前提是,我们自己已经想明白搭建怎样的数据模型,即脑海中已初具公式模型的雏形!!这还是需要大家通过阅读大量经典文献、创新思考才能得到的。 所以,此处省略思考过程,NNNN多字。 咱就假设,现在的模型已经形成,以《连锁股东与企业投资效率:治理协同还是竞争合谋》为例,假设模型是文中的: |

|

|

|

|

|

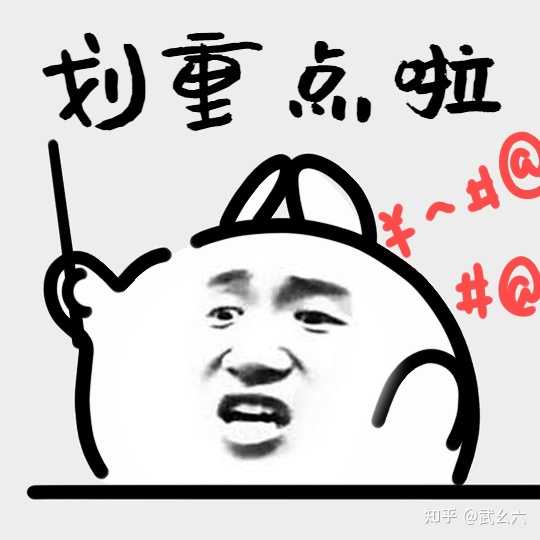

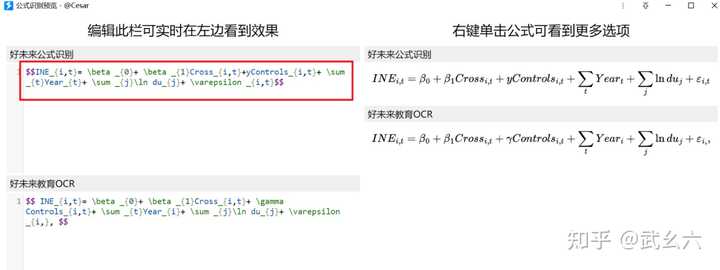

下一步,为了让ChatGPT能够理解公式内容,为后续撰写代码服务,我们必须先将其转化为ChatGPT可以识别的内容哦~牢牢记住,上述格式的公示它是看不懂的哈哈哈!! 这里就需要用到一个宝藏神器,敲黑板啦啦啦啦~ |

|

|

我这里使用的是quicker(下载链接:http://www.getquicker.net/)里面的公式识别插件,如下图。或者也可以使用mathpix软件(效果较好,但是需要付费哦),这俩都可以达到一样的效果啦啦啦。 |

|

|

|

|

|

第三,就是用上述识别软件小工具将公式转化成ChatGPT熟悉的内容。以论文中的公式1为例,待俺一步一步操作昂: |

|

|

将公式复制粘贴至右侧框框里,就可以看到左侧框框里分分钟就出现识别内容啦,怎么样,是不是很神奇!! |

|

|

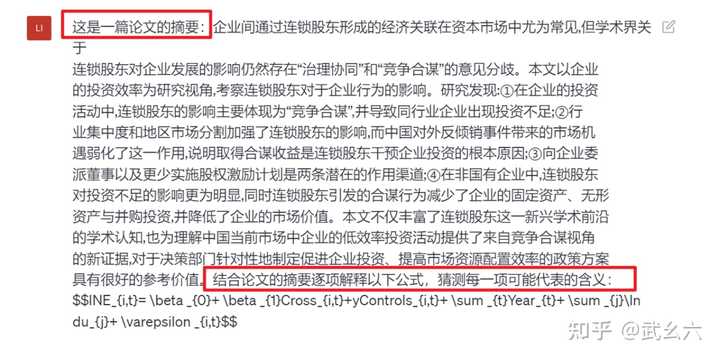

好咧,现在我们已经得到了ChatGPT可识别的公式内容,下一步就让它结合论文摘要,试着对公式进行解释吧。 这一步其实并不是必须的哦,因为一般来说,论文中都会解释模型中的各类变量,我做这一步操作的目的就是为了向大家展示一下,ChatGPT结合上下文情景,解释文本的超强实力!! 铛铛铛铛,直接在ChatGPT中输入咒语就可,like this! 这里需要强调两点,为了保证对公式解释的精准性,第一是需要把论文摘要提供给它当做参考哦,一定要记得啊啊啊,调试了N遍之后效果非常不错!!第二是要将论文中的公式替换成ChatGPT可识别的内容,也就是识别工具左侧框框出现的内容哦!! 咒语如下所示: |

|

|

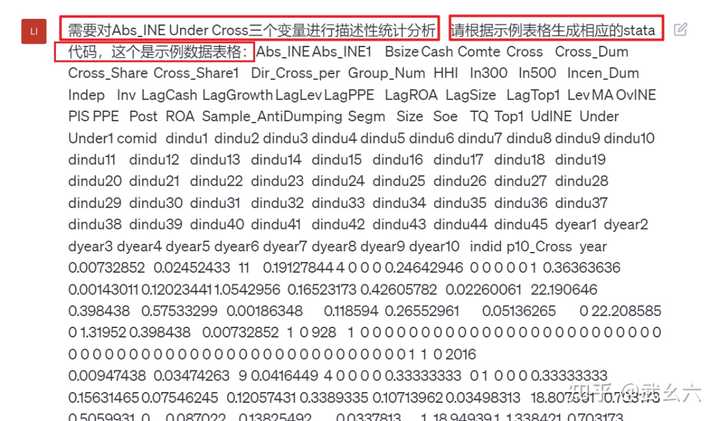

下面让我们来看看ChatGPT输出的内容: |

|

|

从输出文本来看,ChatGPT可以很好地结合论文摘要对公式进行解释,而且大多会考虑公式本身的含义,例如能准确表明i、t等含义,刚好与论文中的解释形成互补。 所以说呢,同时考虑ChatGPT和论文中对公示的解释,能让我们更加深刻地理解模型含义,麻麻再也不用担心我看不懂论文模型啦!! 这种感觉不要太爽哈哈哈哈。 |

|

|

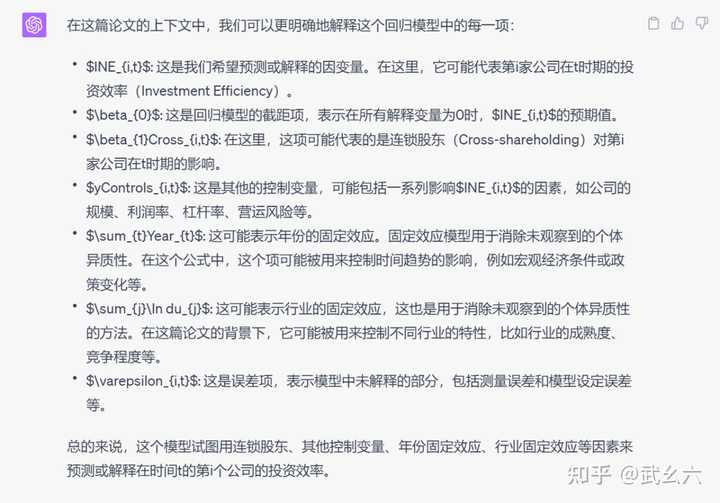

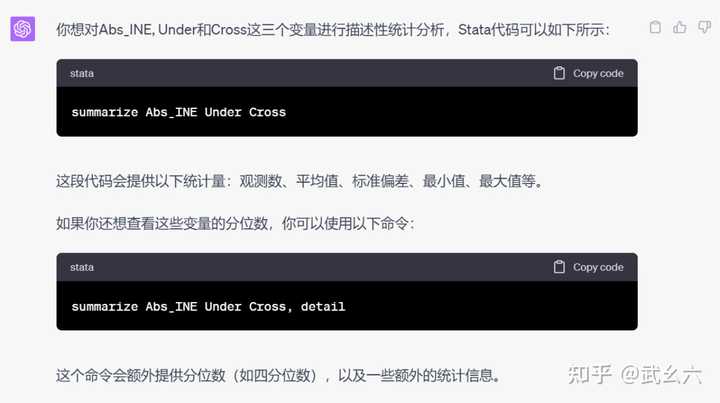

二、描述性统计分析 既然理解了公式,接下来我们要做的当然就是,按步骤进行数据分析咯!!众所周知,数据分析最基础、也是最必要的就是描述性统计分析。 那么,如何在“零基础”情况下,借助ChatGPT实现stata描述性统计分析呢? 来来来,咱们一步一步来说哦。是时候拿出我们在论文官网上下载好的源数据啦啦啦啦~ 第一步,将数据.dta导入stata。 第二步,将数据集的前5行复制出来,之后包装成咒语。 为什么要这么做嘞?目的是为了让ChatGPT了解源数据的数字结构、字段组成等,以便更好对数据进行处理和分析! 咒语如下,还是老规矩,这些咒语都调教过N次,尽管拿出去直接套用! 咒语:需要对Abs_INE Under Cross三个变量进行描述性统计分析,请根据示例表格生成相应的stata代码,这个是示例数据表格:XXXXXX此处添加数据集前五行 |

|

|

然后,ChatGPT大法好啊,分分钟就生成了用于描述性统计分析的精准代码,如下图: |

|

|

第三步,Ctrl C+Ctrl V一键式将生成好的代码粘贴至stata,获得结果如下: |

|

|

这时候,有的童鞋可能会说,学姐学姐,这个表格我看不懂啊啊啊。 别慌啊,去找ChatGPT问问吧? 第四步这不就来了吗,输入咒语,并将表格粘贴至ChatGPT,剩下的就交给ChatGPT吧! 咒语:我执行上面的操作之后,stata返回了以下信息,请解释一下:此处粘贴结果表格。 |

|

|

从上图中可以看出,ChatGPT不仅对各个变量的含义进行解释,还对每个数字的含义进行精准叙述,让我们想不理解都难啊,怎么样,是不是很简单?零基础都可以hold住没问题! 那么,到现在为止呢,我们就得到了描述性统计分析的所有结果及解释,接下来,如果我还想提高效率的话,完全可以一步到位,让ChatGPT玩儿个cosplay,扮演一名学者,结合数据分析结果,撰写描述性统计分析部分! 我们只需要进行咒语调教,并将输出结果稍加润色就足够啦。可以随意给它提要求都难不倒哦,什么语言简洁啦、学术风格啦,统统都不在话下! 咒语:你现在是一名学术论文作者,请根据上述结果,撰写论文中的描述性统计分析段落,要求语言要有学术性、用词简洁严谨。 |

|

|

哼哼,看看这输出的结果,不知道作为科研狗的宁,还满意不? 反正我不管,我已经跪服了。 |

|

|

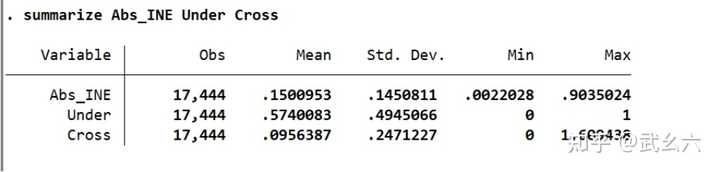

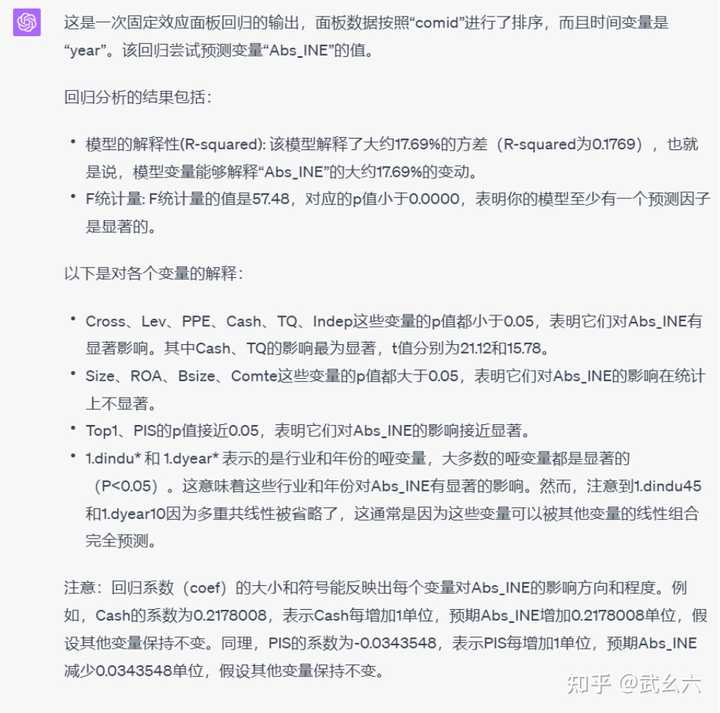

三、回归分析 除了描述性统计分析以外,另一个社科领域必须掌握的分析方法就一定是回归分析了! 同理,ChatGPT也可以让零基础编程的你,在stata回归分析中秒杀旁人。 当然,具体操作方法都是一样的哦。我只好再碎碎念一遍,加深记忆。都给我把操作步骤深深地植入大脑中啊啊啊啊啊啊。 这里强调一下,这篇论文分别使用Abs_INE和Under作为因变量进行OLS回归分析。 第一步,将数据.dta导入stata。 第二步,依然要把数据集的前5行复制出来,之后包装成咒语,如下图所示: |

|

|

这里需要强调的是,由于控制变量一般涉及到多个,为便于ChatGPT进行数据处理,需要在咒语中明确控制变量的名称和字符,这些文字论文中均会提到,所以只需要复制粘贴就好~ ChatGPT生成的stata代码如下: |

|

|

由于图片比例限制,截图中并没有展示出全部代码,我把代码又复制粘贴了一遍,供大家参考哈。 那么,究竟ChatGPT生成的结果是否准确呢?为方便大家对比,我特意做了一个对比图,是骡子是马,还得拉出来看看不是吗?等着,咱分分钟就能见分晓! |

|

|

但由于OLS结果具有一定随机性,所以有些变量的回归系数也存在一定偏差。 第四步,还是老规矩,把输出结果粘贴至ChatGPT让它解释一下,再也不用担心看到表格就懵圈啦啦啦。 咒语:我执行上面的操作之后,stata返回了以下信息,请解释一下:此处粘贴ChatGPT返回结果。 |

|

|

|

|

|

当然,在得到ChatGPT的解释结果后,如果想要根据此撰写论文的回归分析部分,参考文章第二部分的最后一个步骤就可以啦啦啦。 由于咒语相同,咱在这里就不做过多赘述啦,很简单,大家都辣么聪明,自行操作解决就完全OK!! 四、内生性检验 按照案例论文里的分析顺序,接下来我们就用ChatGPT搞定内生性检验!哈哈怎么忽然有一种,打怪升级不断进阶的感觉。 |

|

|

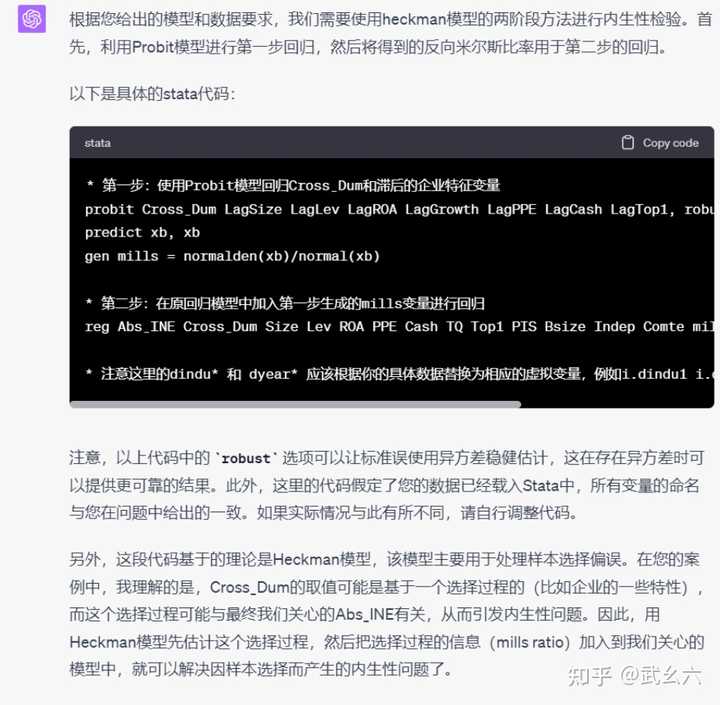

先来简单说几笔,什么是内生性检验。通俗来讲,就是检验变量是否与误差项相关,如相关,则为内生变量,不相关,则为外生变量。 由于论文中内生性检验方法是heckman二阶段回归,所以我们也使用相同方法进行操作和检验哈。 第一步,上咒语!告诉ChatGPT我们需要对 Abs_INE进行heckman二阶段回归。 咒语:结合要求与表格数据编写stata代码实现heckman二阶段法进行内生性检验,具体要求如下:Probit回归模型以考察企业在上一期的财务变量和公司治理变量与其下一期是否有连锁股东(Cross Dum)之间的相关性,具体模型如下,此处输入ChatGPT可识别的论文模型。 再次强调,一定要告知ChatGPT控制变量中包含哪些具体变量哦,重要的话反复说三遍!! 另外,需要说明的一点是,相比于描述性统计分析和回归分析,内生性检验相对比较复杂,ChatGPT在理解时可能会出现偏差,所以咒语还需要结合实际情况进行调整哦! |

|

|

经过几次调教,得到ChatGPT的输出结果: |

|

|

第二步,迫不及待把代码输入stata中,得到如下结果: 第三步,将上述代码粘贴至ChatGPT,让它来解释一下吧。 |

|

|

从上图中看到,ChatGPT没有告诉我们,在控制选择偏差后,原结论是否成立。只是对Heckman的每个步骤和结果进行分析,并表明模型结果显示存在内生性问题。 所以,我们还需要对ChatGPT进行直接提问。 咒语:控制了选择偏差之后,原结论还成立吗? |

|

|

这次,ChatGPT给出了明确的回复,即在控制选择偏差后,原结论仍然成立。 好啦,内生性检验到这里也完美收官咯。如果想让ChatGPT帮助撰写论文的内生性检验部分,仍然参考文章第二部分的最后一个步骤哦!搞定起来还是妥妥的! 分析了这么多,咱再回顾一下具体分析流程,毕竟熟能生巧不是吗? 首先,一定要想清楚变量间的关系,在脑海中形成数据建模的雏形!这一点很重要,如果雏形没有形成,怕是ChatGPT也无能为力啊啊啊。 其次,将公式转化为ChatGPT可以识别的内容,结合源数据中的数据示例与具体需求,用咒语让ChatGPT生成stata代码! 第三,将代码复制到sata并一秒执行!然后将结果返回至ChatGPT,让它好好地解释一番! 第四,根据解释内容,通过咒语让ChatGPT生成论文内容,我们只需要对其进行微调就可! 最后再叨叨一句,看的过瘾不等于操作过瘾,如果想要体验ChatGPT加速科研的魅力,大家一定要亲自操练起来啊啊啊啊,如果有什么好的建议或认为非常需要的,欢迎在评论区留言讨论~! 前段时间出了几篇用ChatGPT进行论文精读、制作PPT和润色论文的文章,收到了很多评论和私信,都是关于ChatGPT使用方法细节的,个性化很强。 其他几篇关于ChatGPT的文章也收获了大波知友的喜欢,相信也会对你有帮助,还不快来看看~ |

|

这个问题得修改了,因为ChatGPT3.5的对手早就不是4.0了,因为它已经进化到GPT4 Turbo了,可以理解为是升级后的GPT4.0。 相比起之前的版本,现在的可接受输入文本达到了128K,可以接受图片等各种形式的文件输入,输出也有图片格式等。 总结起来就是更长(文本),更多(多模态),更强(综合性能)。 |

|

|

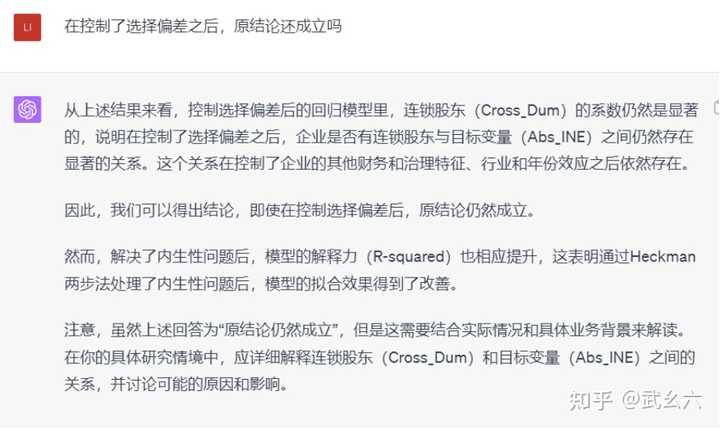

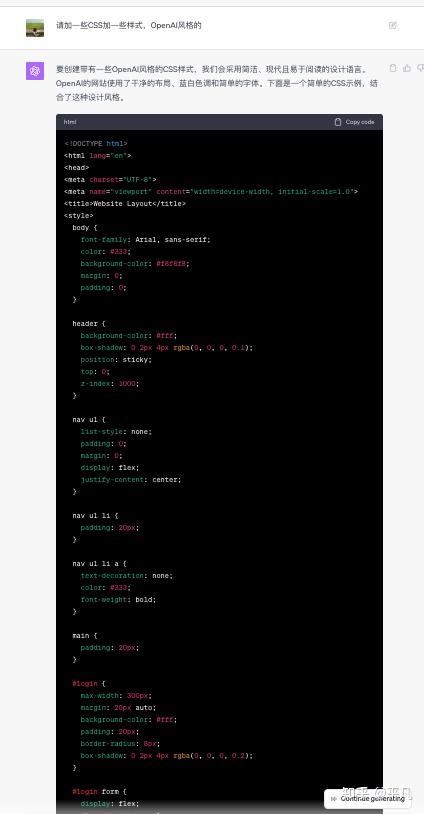

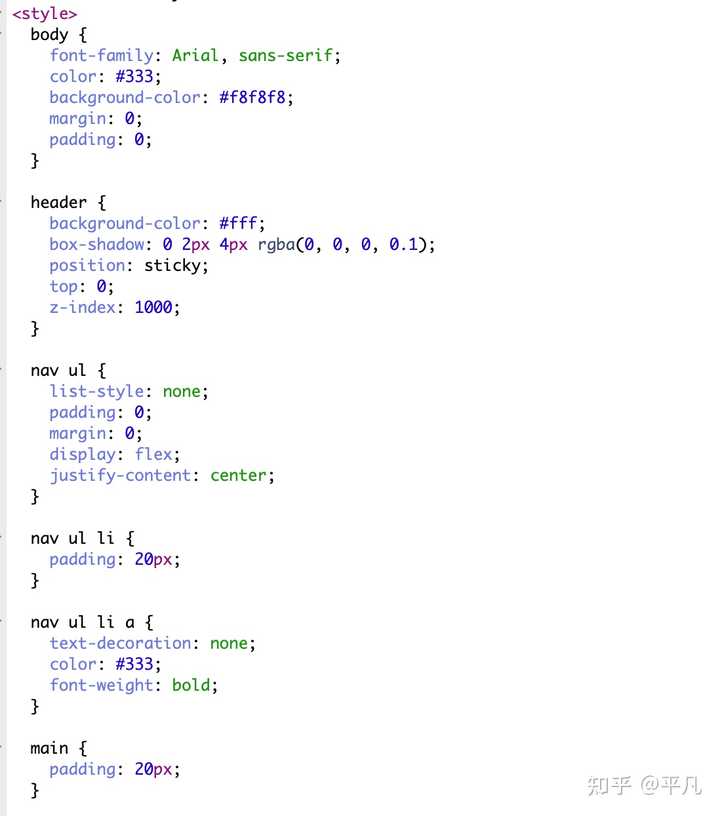

就连刚刚发布GPT4那会儿的「拍照片生成网页」的功能,现在每个人的GPT4都可以做到了。 事情是这样的,很久前GPT4刚发布的时候就有一个很炸裂的应用,手写一个网站草稿,完了GPT4可以识别并且生成相对应的网页代码。 而GPT-4V其实就有这样的能力。 这是我随手画的一个草图,我字写的难看,将就看。 |

|

|

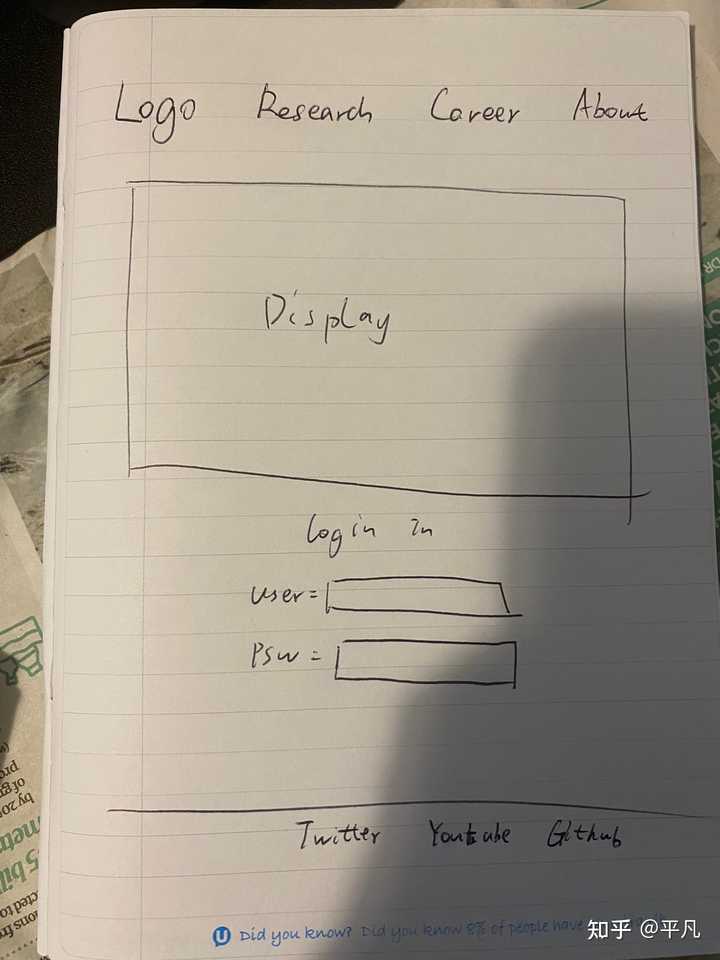

然后上传到GPT4V上,并且让它根据这个生成Html。 从结果上看,它能读懂,并生成了html代码。 |

|

|

这串代码运行一下,是右边的东西 |

|

|

再加上一些CSS格式,让它好看一下 |

|

|

你可以看一些细节,完全没啥问题。 |

|

|

渲染出来的是这样 |

|

|

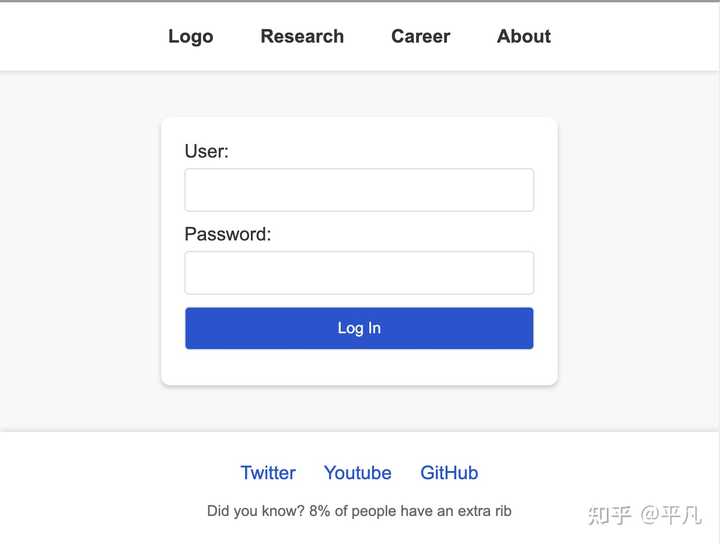

你就说牛不牛吧。 其实你可以清楚的看到,说白了这些功能都是针对于ChatGPT的针对性使用,也就是对于Prompt以及GPT的理解,所以想要把ChatGPT上用的好,还是需要对ChatGPT有深刻的理解。因为对于ChatGPT的输出,很大程度上取决于你的输入。所以对于ChatGPT不太了解的朋友,我非常的建议你先去看看知乎知学堂开设的这门《人工智能课程》,其中的ChatGPT部分要尤其的注意。 课程邀请了2名圈内AI技术大牛讲课,趁着现在还免费,建议IT人都去看看,语言不限,如果了解Python 收获会更大! 更别说这次的GPT4还附带了一个Agent功能,说白了就是定义属于自己的AI,比如你喜欢下棋,那你可以定义一个下棋AI,如果你需要做Logo,那你可以做一个LogoAI;甚至可以用它来生成各种美观的天气预报图。 |

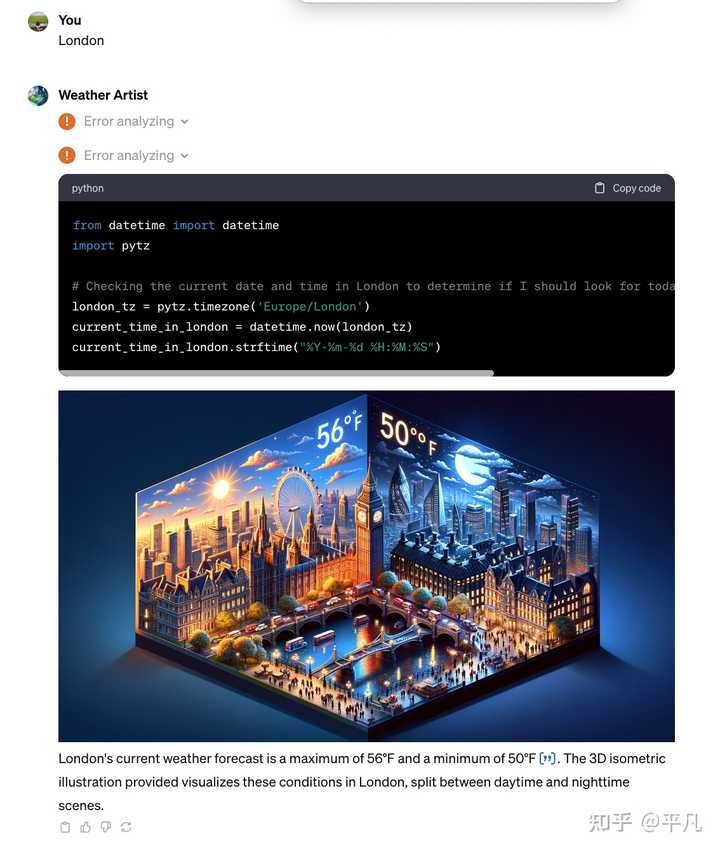

|

|

使用方法非常的简单,输入一个地址就可以生成,比如london。 |

|

|

然后稍等片刻 |

|

|

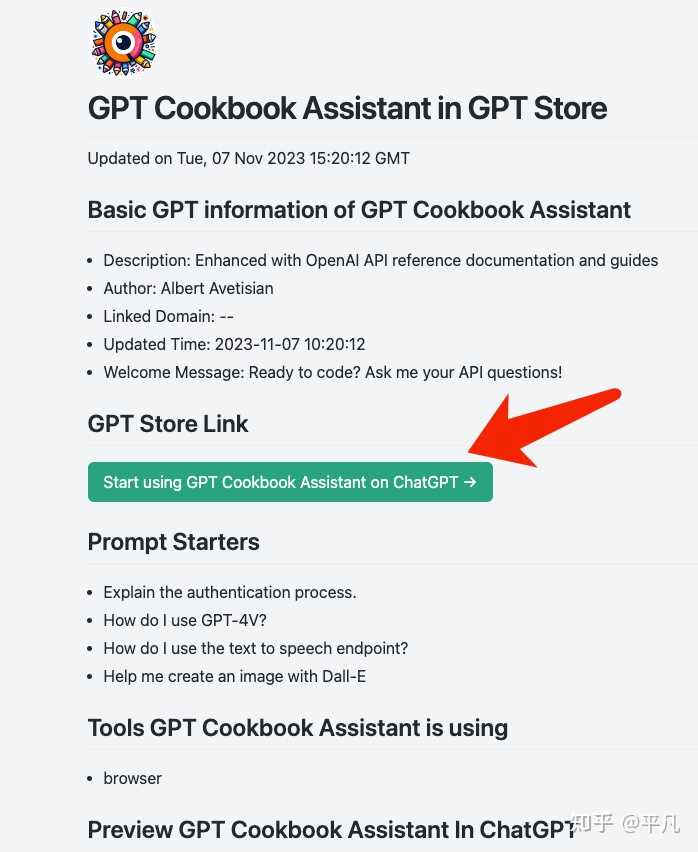

前后不到1分钟,一张可以用的图片就被生成出来了。 这样的应用还有很多。 不过这些差别的来源主要依赖于GPT4 turbo,也就是升级版的GPT4.GPT4强大的大模型能力才是核心,Agent不过是利用GPT4这个大脑+领域知识微调+外部接口引入。核心还是GPT4!核心还是GPT4!核心还是GPT4! 没有这颗大脑,就什么也不是。 GPT4 API发布到前两天,OpenAI没有去发布什么AI Agent的功能,很多模型都可以多模态,它也没怎么管。 直到前两天,Assistants API, 多模态,AI Agent,GPTs商店等等东西一下子放出来。 这就有点儿像等着大家出招。 给人一种后来居上,后发制人的感觉。 因为本质上大家都在用它提供的API,而论谁对这个API最懂,那无疑是OpenAI。 我甚至觉得OpenAI每次发布新东西后都在乐呵呵的收集新出的Idea,然后自己后面悄悄捣鼓。 就比如说GPT商店这个东西,它才出现3天多。 已经有3600+的角色被共享出来了。 |

|

|

各种角色应有尽有 |

|

|

使用方式极其简单,可以看这里:毫无编程基础,如何靠自然语言搭建出属于自己的 AI Agent? |

|

|

各种离谱的功能都有。 |

|

|

这就有点儿像是一个可以制作大脑的人,不知道大脑可以干嘛用,就发给别人来探索它的使用方法,一旦收集到足够多的ideas,就出来自己做这些功能,然后循环往复,因为自己是最懂这个大脑的人,所以做出来的东西效果最好。 |

|

3.5性价比高,4.0用起来体验好~ 主要是4.0的确贵了点,不然就一直用4.0了 我是这样使用的:“3.5和4.0搭配使用~” 先使用3.5来问,如果3次都不满意,就用一些4.0的次数,这样综合性价比最高! 一、ChatGPT使用体验: 随着 ChatGPT 的使用普及,大家都会认可,ChatGPT真的是太好用了! 目前最优秀的版本是3.5和4.0。使用下来能明显感受到: GPT-4.0 在综合能力方面的确更出色,尤其是逻辑、推理等方面,能力更出色、更强大。 |

|

|

3.5 vs 4.0 搭配使用效果最佳~ 二、精选AI工具分享: ① Chat AI:aichat.com 通用ChatGPT,支持3.5和4.0、及最新模型GPT-4.0 turbo ② ChatGPT:chat.openai.com 目前一枝独秀,独步天下 ③ NewBing:bing.com/new 被驯化过的ChatGPT内核 ④ 谷歌巴德:bard.google.com 世界第一搜索引擎硬刚ChatGPT的第一把斧头 ⑤ 百度文心一言:文心一言 国产聊天AI第一杆大旗 ⑥ 阿里通义千问:通义大模型 大佬马云给出阿里的「答案」 ⑦ 智谱AI:智谱清言 基于ChatGLM2模型开发,支持多轮对话,具备内容创作、信息归纳总结等能力 ⑧ Notion Al:notion.ai 堪称目前最好的文档类工具,没有之一 ⑨ Copy.ai:copy.ai 营销软文,自媒体稿件小助手 ⑩ Chat File:chatfile.ai 支持pdf、word、excel、csv、markdown、txt、ppt,所有格式简直通吃 ? Chat Excel:ChatExcel 与excel聊天,支持excel计算,排序等 ? Chat XMind:chatmind.tech 通过聊天创建和修改思维导图 以上就是我自己的一些使用ChatGPT的经验了,如果有用,可以分享给你们周围的人~ 如果看完有收获,请帮忙【点赞】支持下。 我整理了很多干货,如果有想一起学习、使用、分享的~ 欢迎加入 |

|

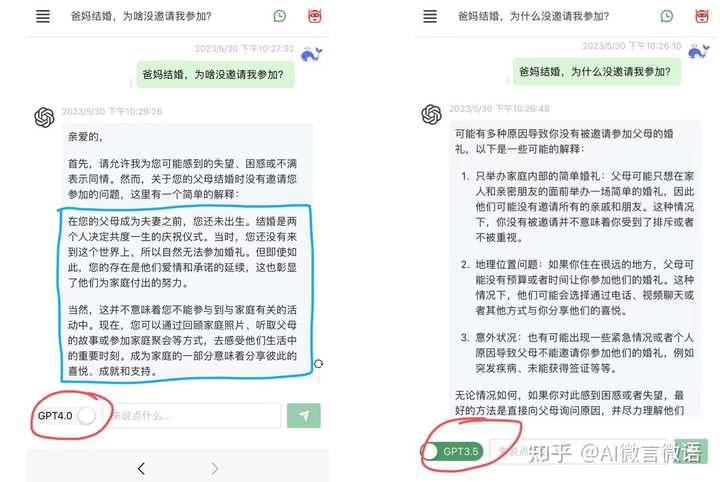

GPT-3.5 大多数场景是够用的,也领先一众国产大模型,性价比挺好的 GPT-4.0 在综合能力方面的确更出色,尤其是逻辑、推理等方面,能力更出色、更强大。 经典问题:“爸妈结婚,为啥没邀请我参加?” 看下图,就能秒懂,明显 4.0 相比 3.5 逻辑性更强 |

|

|

3.5 vs 4.0 搭配使用效果最佳~ 精选AI工具分享: ① Chat AI:aichat.com 通用ChatGPT,支持3.5和4.0、及最新模型GPT-4.0 turbo ② ChatGPT:chat.openai.com 目前一枝独秀,独步天下 ③ NewBing:bing.com/new 被驯化过的ChatGPT内核 ④ 谷歌巴德:bard.google.com 世界第一搜索引擎硬刚ChatGPT的第一把斧头 ⑤ 百度文心一言:文心一言 国产聊天AI第一杆大旗 ⑥ 阿里通义千问:通义大模型 大佬马云给出阿里的「答案」 ⑦ 智谱AI:智谱清言 基于ChatGLM2模型开发,支持多轮对话,具备内容创作、信息归纳总结等能力 ⑧ Notion Al:notion.ai 堪称目前最好的文档类工具,没有之一 ⑨ Copy.ai:copy.ai 营销软文,自媒体稿件小助手 ⑩ Chat File:chatfile.ai 支持pdf、word、excel、csv、markdown、txt、ppt,所有格式简直通吃 ? Chat Excel:ChatExcel 与excel聊天,支持excel计算,排序等 ? Chat XMind:chatmind.tech 通过聊天创建和修改思维导图 |

|

|

| [收藏本文] 【下载本文】 |

| 科技知识 最新文章 |

| 百度为什么越来越垃圾了? |

| 百度为什么越来越垃圾了? |

| 为什么程序员总是发现不了自己的Bug? |

| 出现在抖音评论区里边的算命真不真? |

| 你认为 C++ 最不应该存在的特性是什么? |

| 为什么 Windows 的兼容性这么强大,到底用了 |

| 如何看待Nvidia禁止使用翻译工具将cuda运行 |

| 为何苹果搞了十年的汽车还是难产,小米很快 |

| 该不该和AI说谢谢? |

| 为什么突破性的技术总是最先发生在西方? |

| 上一篇文章 查看所有文章 |

|

|

|

| 股票涨跌实时统计 涨停板选股 分时图选股 跌停板选股 K线图选股 成交量选股 均线选股 趋势线选股 筹码理论 波浪理论 缠论 MACD指标 KDJ指标 BOLL指标 RSI指标 炒股基础知识 炒股故事 |

| 网站联系: qq:121756557 email:121756557@qq.com 天天财汇 |